ChatGPT不是从石头缝里蹦出来的

2023-02-14 11:07:03 作者:admin 文章来源:unknown 阅读次数:742

记者 梁应杰

因为ChatGPT的出现,人类似乎找到了扮演上帝的感觉,给计算机注入了“灵魂”。

过去半个月来,ChatGPT是社交媒体当之无愧的主角。和6年前同样横空出世的AlphaGo不同,这次你我这样大众的感受更为强烈。这也是为什么,作为一款聊天机器人,它用仅仅2个月时间就收获了1亿用户。达到相同的成绩,TikTok用了9个月,更早时的instagram用了30个月。

在产业界,谷歌、百度、阿里等国内外科技巨头争相坐上牌桌,以推出自家版ChatGPT为目标,证明自身在AI领域的深厚积累。

为什么ChatGPT成了绕不开的话题?因为人工智能终于知道如何和人类进行自然交流,给出接近人类表达、认知、需求和价值观的回答,同时展现了成为普通人都能用的先进生产工具,以及未来如“水电煤”一般基础设施的可能性,尽管它依然不完美。

不过,它并不是从“石头缝里蹦出来”的。这是过去20年,以神经网络为主流,推动深度学习发展从量变到质变的结果。其间有无数人类群星和普通人为之闪耀。

了解这些人和事有助于进一步知道ChatGPT是怎么来的,有什么问题,又将带领人类走向何方。

这段有些漫长的旅程从一段刺耳的声音开始。

大力出奇迹?

“ChatGPT缺乏创新,没什么革命性。”这个评价来自一个叫杨立昆的人——在全球几乎一边倒的赞誉声中,颇为格格不入。

杨立昆不是中国人,他的英文名是Yann LeCun,出生在法国。2017年以前,他在中文互联网上有着各种称呼:杨乐昆、杨乐春、严乐村……直到那一年来中国演讲,他官宣了自己的中文名。

如果是单纯的键盘侠,这样的评价不值一笑。但杨立昆恰好是全球为数不多能够对ChatGPT“指手画脚”的人物。

2019年,他和Yoshua Bengio、Geoffrey Hinton一起获得了计算机界的最高荣誉“图灵奖”,被称为“深度学习三巨头”。他们深信,计算机可以像人类一样,依靠神经网络进行“思考”。没有他们,就没有昨天的AlphaGo和今天的ChatGPT。

为什么LeCun会发出这样的感慨呢?ChatGPT的内核是大语言模型,从2018年OpenAI发布的第一代进化到了ChatGPT使用的第四代GPT-3.5,据说GPT-4也已经呼之欲出。

一路升级,OpenAI没有对算法模型进行根本改动,更多是微调了训练机制,以及越来越多人力和算力的投入,从“大力出奇迹”到“更大力出更大的奇迹”。

ChatGPT背后的投入远没有它给出的回复来得“举重若轻”。第一代GPT训练涉及的参数量为1.17亿,到了GPT-3这个数字变成了1750亿,扩容了近1500倍。对应的训练数据量,从5GB扩到了45TB,近万倍的增长。

为了训练GPT-3,OpenAI投入可能达到1200万美元,这还不算背后的微软为它斥资5亿美元建立的超算中心。

所以,搜狐创始人张朝阳表示,ChatGPT的成功是量的积累,包括了机器的算力、服务器的数量以及知识库,“因为训练成本投入过高,没能力的公司只会白白浪费资源。”

到了GPT-3.5,也就是ChatGPT,OpenAI引入了人类反馈强化学习(RLHF)机制。他们找了40个博士,对GPT-3.5针对不同问题给出的三个答案进行打分,建立奖惩模型,最终让机器知道怎样的回答更讨大部分人类喜欢——有人觉得ChatGPT有“讨好型人格”,即来源于此。

不过,RLHF是DeepMind(前沿人工智能企业)首创的。拆解ChatGPT背后的底层技术,类似的情况还有很多。比如,采用的Transformer架构最早由谷歌发明,使用的神经网络语言模型是另一个巨头Yoshua Bengio20多年前提出的,他和LeCun很早就提出让机器“自监督学习”的设想……

因此,在LeCun看来,就底层技术而言,ChatGPT并没有什么特别的创新,也不是什么革命性的东西,“与其说ChatGPT是一个科学突破,不如说它是一个像样的工程实例。”

然而,对绝大多数人而言,这道不断站在巨人肩膀上,穿行了80年的微光已经足够耀眼。

至暗时刻里的三个臭皮匠

如今深度学习仰仗的神经网络,最早被提出是在1943年,距今刚好80年。其间,包括冯·诺依曼在内的天才都做过探索,但收效甚微。上世纪80年代,整个科学界已是“符号主义”的天下,“神经网络”的研究已经停滞了近20年,整个人工智能的发展也陷入了寒冬。

符号主义认为,用符号运算和逻辑推理就能让计算机拥有人的智慧。神经网络的支持者则坚信,要参照人类大脑的神经网络让计算机智能起来。

那会儿神经网络的支持者,就像是挡在六大门派前的张无忌。其中的代表人物,就是“深度学习三巨头”。

Geoffrey Hinton,1947年出生,现任谷歌副总裁兼工程研究员。他出生在一个英国学术“豪门”, 父亲是昆虫学家,母亲是教师,叔叔发明了“国民生产总值”(GNP)概念,高祖父发明的布尔代数奠定了现代计算机科学的基础。

然而,直到获得“图灵奖”,Hinton也从未正式上过计算机课程。他学过生理学、物理学、哲学、心理学,却不怎么懂数学、神经科学和计算科学,研究过程中不断要向带的学生来请教。就是这么一个“门外汉”,凭借BP算法、玻尔兹曼机和改进卷积神经网络,不仅自己敲开了计算机最高殿堂的大门,还带着深度学习冲破了黑暗。

“反向传播算法”(BP算法)曾在20世纪80年代末为神经网络的研究注入了一针强心剂。在这一算法的支持下,计算机有了根据给出的参考答案进行“自我纠正”的能力。只是由于算法不完善和计算机算力不足,没能进一步发展。

Yoshua Bengio出生在1964年,和Yann LeCun一样是法国人,现在是加拿大蒙特利尔大学教授。他出生在一个嬉皮士家庭,童年是个典型的书呆子,最好的朋友是兄弟Samy(谷歌大脑联合创始人),以及两人通过卖报赚钱买来的计算机。

区别于另外两个巨头,Bengio绝大部分精力放在学术研究上,和产业保持了一定的距离,相关论文被引用超17万次。

他凭借序列的概率模型、高维词汇嵌入和注意机制以及生成对抗网络(GAN)获得了“图灵奖”。GAN是2014年,Bengio与Ian Goodfellow一同推出的,让计算机学会了“左右互搏”,捅破了机器成长的天花板,为“强化学习”奠定了基础。

两人还和Aaron Courville等人合著了《Deep Learning》(《深度学习》)一书,成了人手一本的“AI圣经”。

然后就是一直以心直口快著称的Yann LeCun,1960年出生,现任Meta首席AI科学家。他对于人工智能的兴趣,是在9岁观看《2001太空漫游》时种下的。现实世界里,他也是第一批让机器“睁眼看世界”的人,只不过看的是支票上的手写字。

这得益于1989年他构建的机器视觉卷积神经网络LeNet。过去10年,卷积神经网络(CNN)已经成为深度学习的基础技术。除了CNN,他比Hinton更早尝试构建BP算法,还拓展了神经网络的视野。

无论是在学术上还是心理上,Hinton都是Bengio和LeCun的领路人。1987年,LeCun短暂加入过Hinton的实验室。而Bengio从本科开始,就站在了Hinton的肩膀上,一路成长为巨人。

Bengio 说Hinton 有“穿透黑暗看清事物”的能力。他在潜心研究神经网络时长期受腰椎疾病困扰,两任妻子先后罹患癌症,但他始终坚信,错的是其他人。如今,Hinton 被誉为“深度学习之父”。

因此不难理解,在以LeCun为代表的科学家眼里,真正的创新对应的是BP算法、GAN、CNN等等,它们才构成了如今深度学习的基石。

(下转04版)

赵露思球操高清图片【附视频】

赵露思球操高清图片【附视频】 心态崩了看片这么多年女主角是谁【图片来源】

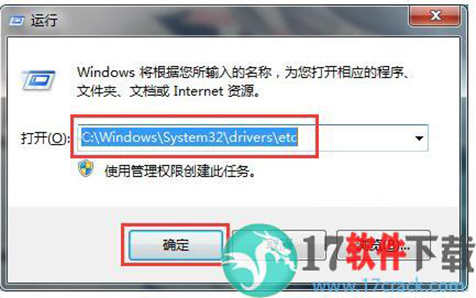

心态崩了看片这么多年女主角是谁【图片来源】 PowerDVD19激活教程(附图文安装教程)

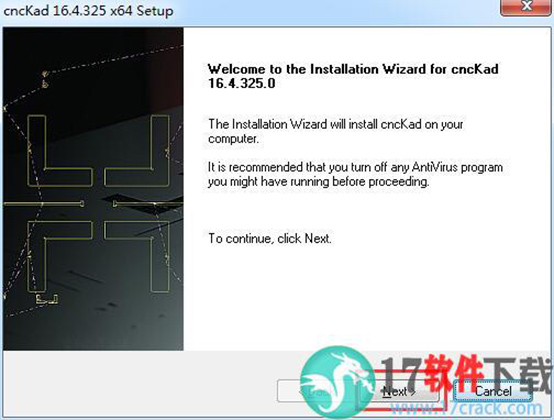

PowerDVD19激活教程(附图文安装教程) cnckadv16破解版安装教程图解

cnckadv16破解版安装教程图解 Zlata柔术超清图片壁纸

Zlata柔术超清图片壁纸 VERICUT9.0详细安装破解教程

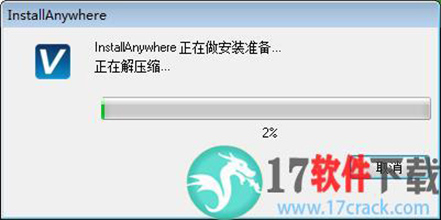

VERICUT9.0详细安装破解教程 Carlson Civil Suite

Carlson Civil Suite IntelliJ IDEA

IntelliJ IDEA Portraiture

Portraiture offline

offline Rhinoceros

Rhinoceros Mirillis Action

Mirillis Action keyshot

keyshot Goodsync

Goodsync xshell7

xshell7 SketchUp

SketchUp PHPStorm

PHPStorm